قالب های فارسی وردپرس 11

این وبلاگ جهت دسترسی آسان شما عزیزان به قالب های برتر وردپرس به صورت فارسی تدوین و راه اندازی شده است.قالب های فارسی وردپرس 11

این وبلاگ جهت دسترسی آسان شما عزیزان به قالب های برتر وردپرس به صورت فارسی تدوین و راه اندازی شده است.از پیشرفتهای هوش مصنوعی در تقلید رفتارهای انسانی باید ترسید؟

اگر از طرفداران پروپاقرص فناوریهای انقلابی بوده باشید، پس احتمالا میدانید که تاکنون چندین و چند بار از خطرات مربوطبه پیشرفت خارجازکنترل هوش مصنوعی صحبت به میان آمده و از دانشمندانی نظیر استیون هاوکینگ تا سیاستمدارانی چون هنری کیسینجر همگی از آیندهای تاریک سخن گفتهاند که با فرارسیدن «نقطهی تکینگی فناوری» برای بشر رقم خواهد خورد. ایدهای که در پس این پیشگوییها دیده میشود آن است که با آغاز خلاقیت در سیستمهای هوش مصنوعی، آنها قادر خواهند چیزهای بزرگی خلق کنند که ممکن است برای خود ما کمی ترسناک جلوه کند. برای مثال، یک برنامهی هوش مصنوعی که اجازه میدهد کاربران بتوانند همراهبا یوهان سباستیان باخ در دنیای مجازی آهنگسازی کنند؛ بدینصورت که کاربران میتوانند با واردکردن نُتهای خود به برنامه، هارمونیهایی متناسب بهسبک باخ دریافت کنند.

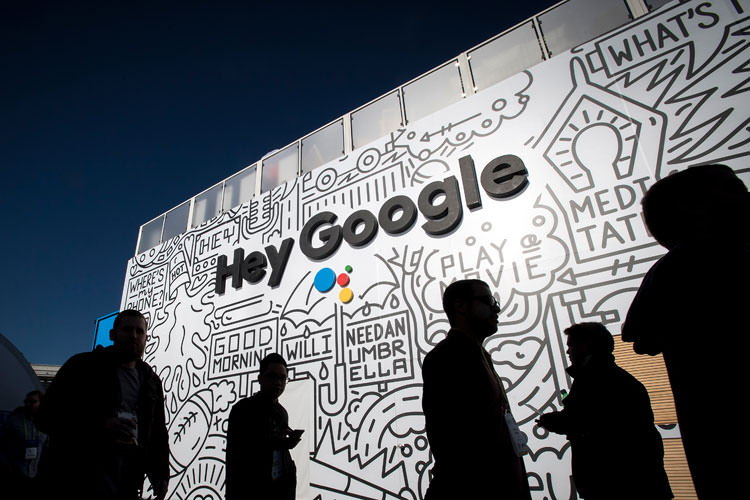

این برنامه توسط گوگل اداره میشود و به خاطر نوآوری خارقالعاده و جنبهی سرگرمی خود، تحسین زیادی را برانگیخته است. اما در روی دیگر سکه، انتقاداتی را نیز متوجه خود کرده و نگرانیها را در مورد خطرات هوش مصنوعی افزایش داده است.

اما آنچه که در واقعیت با آن مواجه هستیم، فراتر از نگرانی در اینباره است که آیا الگوریتمها روزی میتوانند یک موسیقی یا هنر خلق کنند یا خیر. دراینمیان، برخی از نگرانیها کماهمیتتر جلوه میکنند، درحالیکه ممکن است واقعا هم این طور نباشد؛ نظیر ملاحظاتی که میگویند سیستم هوش مصنوعی گوگل درحال شکستن قوانین بنیادین تصنیف موسیقی است. حقیقت آن است که تلاشها درجهت وادار کردن کامپیوترها به تقلید رفتارهای انسانی میتواند کمی گیجکننده و بالقوه آسیبرسان باشد.

فناوریهای جعل هویت

برنامهی گوگل با تجزیهوتحلیل نُتهای موجود در ۳۰۶ قطعه از آثار هنری باخ توانسته هارمونی پنهان در این ملودیها و نتها را کشف و شناسایی کند. از آنجا که باخ در تصنیفهای خود از قوانین سختگیرانهای تبعیت میکرد، این برنامه توانست بهطور موثری این قوانین را فرا گیرد و اکنون میتواند آنها را درمورد نُتهای ارائهشده ازسوی کاربران نیز اعمال کند.

با اینکه اپلیکیشن باخ بهخودیخود یک محصول جدید است؛ اما فناوری زیربنایی آن پیشازاین نیز وجود داشته است. مدتهای مدیدی است که ما الگوریتمهایی دراختیار داریم که برای تشخیص الگوها آموزش میبینند و براساس توابع احتمال تصمیمگیری میکنند. برخی از این الگوریتمها بهقدری پیچیده هستند که بسیاری از افراد حتی نمیتوانند درک کنند که روند تصمیمگیری یا تولید نتیجه در آنها بهکلی چگونه رخ میدهد.

سیستمهای هوش مصنوعی بینقص نیستند؛ بسیاری از آنها به دادههایی تکیه دارند که شاخص مناسبی از کل جمعیت نیست یا تحتتاثیر سوگیریهای عمدی و تعصبات انسانی قرار دارند. بدتر آنکه حتی بهدرستی روشن نیست که درصورت بروز خطاها یا ایجاد مشکلات حادتر ازسوی این نوع سیستمها، باید تقصیر را متوجه چه فرد یا گروهی دانست.

در حال حاضر، فناوریهای هوش مصنوعی به اندازهای پیشرفت کردهاند که میتوانند سبک نوشتاری یا گفتاری افراد و حتی حالات چهره آنان را بهخوبی تقلید کنند.

این دستاورد چندان هم بد نیست؛ کمااینکه یک هوش مصنوعی نسبتا ساده با قابلیتی نظیر پیشبینی کلمات پرکاربرد توانست به استیون هاوکینگ کمک کند ارتباط مؤثرتری را با افراد جامعه برقرار کند.

برنامههای پیچیدهتری که صداهای انسانی را تقلید میکنند، میتوانند به افراد دارای معلولیتهای تکلمی کمک کنند؛ اما ازسوی دیگر، میتوانند برای فریبدادن شنوندگان نیز بهکار روند. برای مثال، سازندگان یک برنامهی تقلید صدا بهنام Lyrebird، ویدئوی مربوطبه یک مکالمهی شبیهسازیشده میان باراک اوباما، دونالد ترامپ و هیلاری کلینتون منتشر کردهاند که در نگاه اول بسیار واقعی به نظر میرسد، درحالیکه چنین مکالمهای هرگز روی نداده است.